ปั้นกลยุทธ์สู่โซลูชันที่ใช้งานจริง AI-Native Products

รายงาน State of AI in Business 2025 ฉบับล่าสุดจาก MIT ระบุว่า 95% ของโปรเจกต์ AI ประสบความล้มเหลว โดยสาเหตุส่วนใหญ่ไม่ได้มาจากด้านเทคโนโลยี แต่เป็นเพราะทีมไม่สามารถผลักดันโปรเจกต์จากขั้นต้นแบบไปสู่การใช้งานจริงได้ ความท้าทายจึงไม่ได้อยู่ที่การสร้าง AI แต่อยู่ที่การขยายผลอย่างปลอดภัยและยั่งยืนในระบบธุรกิจ

จากประสบการณ์ของผม ความล้มเหลวส่วนใหญ่ไม่ได้เกิดจากการที่ทีมขาดความมุ่งมั่นตั้งใจแต่เกิดจากการที่พวกเขาประเมินวินัยที่ต้องใช้ในการเปลี่ยนผ่านจากขั้นทดลองไปสู่การใช้งานจริงต่ำเกินไป

ความสำเร็จจำเป็นต้องมีแนวทางที่เป็นระบบ และมีสมดุลระหว่างการทดลองอย่างรวดเร็วกับความพร้อมในการปฏิบัติงานจริง

จากไอเดีย AI สู่โซลูชันที่ขยายผลได้ใน 4 ขั้นตอน

การสร้างผลิตภัณฑ์ AI-Native นั้นมีเส้นทางที่ชัดเจน ตั้งแต่แนวคิดเริ่มต้นไปจนถึงโซลูชันที่สามารถขยายผลได้ ซึ่งสามารถแบ่งออกเป็น 4 ระยะที่ชัดเจน

1. กำหนดปัญหา

โปรเจกต์ AI ที่ดีที่สุดจะเริ่มต้นจาก Pain Points ที่ชัดเจน ไม่ใช่การวิ่งตามเทรนด์เทคโนโลยี ขั้นตอนแรกคือการพูดคุยกับผู้ใช้ ตรวจสอบข้อมูลสถิติ และศึกษากระบวนการทำงาน เพื่อหาจุดที่ AI สามารถเข้าไปสร้างประโยชน์ได้จริง

โจทย์ที่ใช่แก่การนำ AI มาใช้มักจะมีลักษณะร่วมกันคือ เป็นงานที่มีขั้นตอนยุ่งยากซับซ้อนสูง มีปริมาณงานเยอะและสามารถสร้างผลลัพธ์ที่วัดผลได้ชัดเจนหากทำสำเร็จ คุณควรมองหางานที่ต้องทำซ้ำ ๆ อย่างการทำรายงานหรือการคัดกรองปัญหา ข้อมูลที่กระจัดกระจายอยู่ตามแหล่งต่าง ๆ ปัญหาคอขวดในการตัดสินใจที่ทีมต้องรอผลการวิเคราะห์ หรือช่องว่างด้านประสบการณ์ผู้ใช้ในงานบริการลูกค้าและการสร้างประสบการณ์เฉพาะบุคคล

2. ทดสอบด้วย Proof of Concept

เมื่อมีปัญหาที่ชัดเจนแล้ว สิ่งสำคัญคือต้องทดลองอย่างรวดเร็วเพื่อพิสูจน์ความเป็นไปได้ในทางเทคนิคก่อนเริ่มการลงเงินจำนวนมาก ซึ่งแพลตฟอร์มสมัยใหม่ทำให้การทดลองนี้เข้าถึงได้ง่ายขึ้น เช่น Azure AI Foundry มีพื้นที่ทดลองที่รองรับได้หลายโมเดล พร้อมระบบประเมินผลในตัว Google AI Studio ช่วยให้สามารถทดลอง Gemini ได้อย่างรวดเร็ว และสามารถส่งผลลัพธ์ออกไปยัง Vertex AI ได้ Anthropic Console มีเครื่องมือสำหรับการปรับแต่ง Prompt ของ Claude ที่มีความสามารถในการให้เหตุผลเชิงลึก และ Amazon Bedrock ให้บริการการทดสอบด้วยหลายโมเดลที่มาพร้อมความน่าเชื่อถือระดับองค์กรจาก AWS

"เป้าหมายสำคัญในขั้นตอนนี้คือ การพิสูจน์ให้เห็นคุณค่าอย่างรวดเร็ว ควบคู่ไปกับการเรียนรู้ว่าสิ่งใดใช้ได้ผลและสิ่งใดใช้ไม่ได้ผล"

.jpg?width=1852&height=1852&name=2023_VP%20Engineering_Leif%20Mork_02%20(1).jpg)

Leif Mork

VP ของ Digital Products ที่ Seven Peaks

3. สร้างผลิตภัณฑ์ Minimum Viable Product (MVP)

ในขั้นตอนต่อมา คุณสามารถเชื่อมต่อ AI เข้ากับระบบการทำงานจริง และเริ่มเปิดให้ผู้ใช้กลุ่มแรกเข้าถึงได้ ผ่านแอปพลิเคชัน บอต หรือผ่านการเชื่อมต่อระบบคุณสามารถทำได้ด้วยเครื่องมือต่างๆ เช่น endpoints ของ Azure AI Foundry, Agent Builder ของ Google Vertex AI, API ของ Anthropic, Assistants ของ OpenAI หรือ Agents ของ Amazon Bedrock ซึ่งแต่ละเครื่องมือต่างก็มีช่องทางในการเชื่อมต่อกับ Slack Teams เว็บไซต์ และแพลตฟอร์มบนมือถือ

MVP ของคุณควรทำงานได้จริงมากเพียงพอต่อการรวบรวมข้อเสนอแนะจากการใช้งานจริง ในขณะเดียวกันก็ต้องเจาะจงมากเพียงพอ ที่จะสามารถสร้างได้อย่างรวดเร็ว

4. ขยายระบบอย่างปลอดภัย

ท้ายที่สุด ก่อนที่คุณจะนำไปใช้งานจริงเต็มรูปแบบ คุณจำเป็นต้องเพิ่มการกำกับดูแล การติดตามตรวจสอบ และการควบคุมระดับองค์กรไว้ให้พร้อมเสียก่อนเครื่องมือต่าง ๆ เช่น Azure Application Insights สำหรับการติดตามประสิทธิภาพ Google Vertex AI สำหรับการตรวจจับความคลาดเคลื่อนของข้อมูล หรือ Amazon Bedrock สำหรับการกำกับดูแล ที่จะช่วยจัดการการเข้าถึงและการแจ้งเตือน

สิ่งเหล่านี้ไม่ใช่ทางเลือก แต่มันคือสิ่งที่แยกระหว่างตัวทดลองออกจากระบบที่องค์กรใช้งานจริงที่ได้รับความไว้วางใจจากผู้ที่มีส่วนได้ส่วนเสีย

สำหรับทีมที่เพิ่งเริ่มต้น ควรโฟกัสที่ use case ที่เฉพาะเจาะจงเพียงจุดเดียว โดยเลือกจุดที่ข้อมูลสะอาด วัดผลได้ และเป็นกระบวนการที่เกิดขึ้นซ้ำ ๆ ความสำเร็จในช่วงแรกจาก AI workflow เพียงหนึ่งจุดมักจะช่วยปลดล็อกโมเมนตัม ให้เกิดขึ้นทั่วทั้งองค์กร

จากคำแนะนำสู่การปฏิบัติจริง

Model Context Protocol: มาตรฐานใหม่

ลองจินตนาการถึงเวลาคุณสั่ง AI: "จองตั๋ว Mission Impossible ในโรงภาพยนต์ที่ใกล้ฉันมากที่สุด รอบระหว่าง 6 โมงเย็นถึง 3 ทุ่ม" หากเป็นปีที่แล้ว AI จะนำลิงก์ของเว็บไซต์ของโรงภาพยนต์มาให้คุณ และแนะนำรอบฉายต่าง ๆ ให้คุณไปจองด้วยตัวเอง แต่วันนี้ ด้วย Model Context Protocol (MCP) AI สามารถจัดการจองตั๋วให้คุณได้ ตั้งแต่ต้นจนจบ

MCP ถือเป็นการเปลี่ยนแปลงครั้งสำคัญในวิธีที่ AI มีปฏิสัมพันธ์กับระบบต่าง ๆ แทนที่ AI จะทำได้เพียงเสนอแนะการดำเนินการต่าง ๆ MCP ช่วยให้ AI สามารถสั่งการสิ่งเหล่านั้นได้โดยตรง ผ่าน interfaces ที่มีโครงสร้างชัดเจน สามารถค้นหาหรือเรียกใช้งานได้ และปลอดภัย เรามาดูการทำงานของมันกับตัวอย่างการจองตั๋วหนังของเรากัน

Agent คิดและสั่งการอย่างไร

เมื่อคุณส่งคำขอจองตั๋ว Agent ที่ทำงานด้วย MCP จะเริ่มค้นหา actions ที่พร้อมใช้งานก่อน มันจะเข้าใจได้เองว่ามันสามารถค้นหาโรงภาพยนต์ ค้นหาภาพยนตร์ ดูที่นั่งว่าง และจองตั๋วได้ คุณสมบัติในการค้นพบความสามารถด้วยตนเองนี้หมายความว่า AI ไม่จำเป็นต้องมีคำสั่งที่ตายตัวสำหรับทุก ๆ งาน

|

|

|

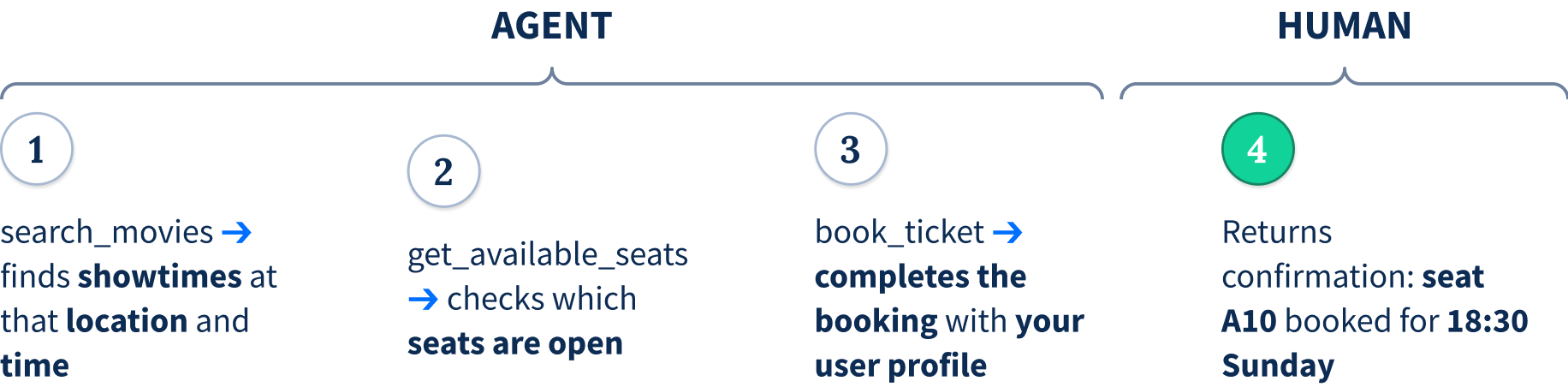

Agent จะเริ่มต้นการวางแผน มันจำเป็นต้องค้นหาภาพยนตร์และสถานที่ที่ถูกต้อง ภายในช่วงเวลาที่กำหนดไว้ มันจึงสั่งการ search_movies ซึ่งระบบจะส่งผลลัพธ์เป็นรอบฉายของ Mission Impossible ที่โรงภาพยนตร์ที่อยู่ใกล้คุณมากที่สุดกลับมา พบว่ามีรอบ 18:30 น. และรอบ 20:15 น. ซึ่งทั้งสองรอบก็อยู่ในช่วงเวลาที่คุณต้องการพอดี

Agent จะสั่งการผ่าน execution layer โดยเรียกใช้ get_available_seats สำหรับรอบ 18:30 น. ระบบของโรงภาพยนตร์ก็จะแสดงผังที่นั่งขึ้นมา ในขณะเดียวกัน ระบบความจำของ Agent จะดึงข้อมูลความชอบในอดีตของคุณขึ้นมา ซึ่งก็คือการที่คุณมักจะเลือกที่นั่งริมทางเดินบริเวณโซนกลาง

ก่อนการยืนยันที่นั่ง Agent จะใช้ขั้นตอนการสอบถามผู้ใช้เพื่อยืนยันความถูกต้อง โดยการถามว่า "เจอรอบฉาย 2 รอบ รอบ 18:30 น. มีที่นั่งในโซนที่คุณชอบว่างมากกว่า ให้จองที่นั่ง A10 กับ A12 เลยไหม" เมื่อคุณยืนยัน Agent ก็จะสั่งการ book_tickets ด้วยข้อมูลโปรไฟล์ของคุณ และระบบก็จะแจ้งผลการยืนยันกลับมา

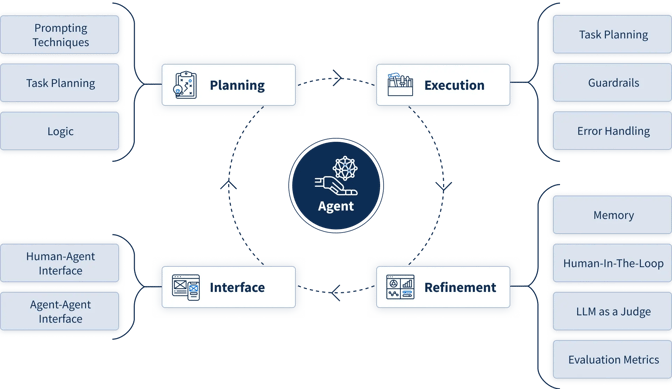

โครงสร้างการทำงานแบบ Agent

Guardrails คอยดูแลเรื่องความปลอดภัยตลอดทั้งกระบวนการทำงานนี้ Agent จะไม่สามารถทำการจองได้ หากไม่ได้รับการยืนยันก่อนสำหรับยอดซื้อที่สูงเกินเกณฑ์ที่กำหนดไว้ โดยระบบจัดการข้อผิดพลาดจะดักจับปัญหาต่าง ๆ เช่น รอบฉายที่เต็มแล้ว และระบบการจำกัดจำนวนครั้งจะช่วยป้องกันการจองซ้ำโดยไม่ตั้งใจ องค์ประกอบที่มีโครงสร้างชัดเจนเหล่านี้ ทั้งตรรกะในการวางแผน การสั่งการผ่านเครื่องมือ กลไกการยืนยันจากผู้ใช้ และกรอบป้องกันความปลอดภัย จึงสามารถประกอบกันเป็นสถาปัตยกรรมของระบบ Agentที่มีความน่าเชื่อถือ

ระบบอัตโนมัติ vs. ระบบผู้ช่วย

ความสามารถใหม่นี้นำมาสู่คำถามข้อสำคัญคือ แล้วเมื่อไหร่ AI จึงจะควรทำงานแบบอัตโนมัติ หรือทำหน้าที่เป็นผู้ช่วย ตัวอย่างการจองตั๋วภาพยนต์ของเราใช้งานได้ผลเพราะเป็นงานที่มีโครงสร้างชัดเจน และทำซ้ำได้ ผลลัพธ์สามารถตรวจสอบความถูกต้องได้โดยอัตโนมัติ และผู้ใช้ก็ต้องการประหยัดเวลาด้วยการลดภาระงานทั้งหมดนี้ออกไป

แต่ก็ไม่ใช่ทุกกรณีที่จะเหมาะกับการทำงานแบบอัตโนมัติ หากคุณกำลังจองงานอีเวนต์ของบริษัทที่มีผลกับงบประมาณ วางแผนขั้นตอนการรักษาพยาบาล หรือเจรจาต่อรองสัญญา คุณย่อมต้องการ AI ที่ทำหน้าที่เป็นผู้ช่วย เพื่อมาช่วยเสริมการตัดสินใจของคุณ มากกว่าที่จะให้มันลงมือทำแทน เนื่องจากสถานการณ์เหล่านี้ล้วนมีผลกระทบในเชิงกฎหมาย การเงิน หรือบุคคล ซึ่งจำเป็นต้องอาศัยวิจารณญาณ และการอนุมัติจากผู้ใช้งาน

เมื่อ AI สามารถสั่งการผ่าน MCP ได้ มันควรเป็นแค่ผู้ช่วย หรือควรทำงานแทนไปเลย

AI ที่ทำงานแทน |

AI ที่คอยช่วย |

|---|---|

|

ดำเนินการแทนคุณ โดย AI จะเป็นผู้ตัดสินใจและลงมือทำภายใต้กรอบป้องกันที่กำหนดไว้ |

เสริมการตัดสินใจของผู้ใช้ โดย AI จะเป็นผู้เสนอแนะ และคุณเป็นผู้ตัดสินใจ |

|

ลักษณะของงานมีโครงสร้าง และกฎเกณฑ์ที่ชัดเจน หรือเป็นงานที่ทำซ้ำได้

ผลลัพท์จะถูกตรวจสอบโดยอัตโนมัติ

|

มีผลกระทบทางด้านกฎหมาย การเงิน หรือบุคคล

เป็นงานที่ต้องการวิจารณญาณ และการตัดสินใจจากผู้ใช้

|

องค์กรที่ปรับตัวเก่งที่สุดจะผสมผสานทั้งสองแนวทางนี้เข้าด้วยกันอย่างมีชั้นเชิง โดยจะปล่อยให้ AI ดำเนินการในส่วนที่เหมาะสม แต่ยังคงให้มนุษย์เข้ามามีส่วนตัดสินใจในจุดที่สำคัญที่สุด

ก้าวสู่อนาคตแบบ Headless ด้วยรากฐานที่มีโครงสร้าง

เพื่อเตรียมพร้อมสำหรับโครงสร้างการทำงานแบบ Agent ด้วย MCP โครงสร้างระบบของคุณจะต้องถูกออกแบบมาอย่างมีจุดประสงค์ และต้องแยกส่วนการทำงานออกจากกันอย่างชัดเจน

API Layer ที่เป็นระบบ

กล่าวคือ ต้องมีการออกแบบ endpoints ของ REST หรือ GraphQL ที่ชัดเจน สอดคล้องกัน และมีการระบุเวอร์ชัน การออกแบบที่เน้นการกระทำเป็นหลัก นั้นมีประสิทธิภาพที่สุด โดยจะทำให้เห็นการทำงานของธุรกิจที่มีความหมาย แทนที่จะเป็นเพียงการทำงานแบบ CRUD สิ่งสำคัญอีกประการคือการกำหนดข้อกำหนดของ input-output ที่ชัดเจน เพื่อกำจัดการคาดเดา และการใช้ระบบรักษาความปลอดภัยในจุดที่ AI ทำหน้าที่เสมือนเป็นผู้ใช้รายหนึ่ง ซึ่งจำเป็นต้องมีการยืนยันตัวตน การจำกัดจำนวนการใช้งาน และการเก็บบันทึกประวัติการใช้งาน

กลยุทธ์บูรณาการแบบแยกส่วน

เพื่อให้ระบบมีความยืดหยุ่น การเรียกใช้งานโมเดลทั้งหมดจะต้องผ่าน backend หรือ API gateway ของคุณเอง โดยไม่อนุญาตให้ทีม frontend เรียกใช้งาน AI vendors โดยตรง การเปิดให้เรียกใช้ AI ผ่าน API ที่ชัดเจนและมีเวอร์ชันที่ทำหน้าที่ซ่อนความซับซ้อนไว้ จะช่วยให้เราสามารถ wrap ฟีเจอร์ของ LLM ไปไว้ใน SDK เพื่อให้ frontend นำไปใช้งานต่อได้ traffic ทั้งหมดจึงยังคงอยู่ภายใต้การควบคุมของ API ของเรา และการใช้ event streams หรือ webhooks จะช่วยให้ระบบทำงานแบบ Asynchronous ได้ ซึ่งระบบปลายทางสามารถตอบสนองต่อผลลัพธ์จาก AI ได้โดยไม่ต้อง direct coupling

วิธีนี้ช่วยให้ SDK หรือ platform layer ของคุณรับผิดชอบจัดการเรื่องการ retry rate limits และพฤติกรรมเฉพาะตัวของโมเดล ซึ่งช่วยปลดภาระให้ทีม frontend สามารถมุ่งเน้นไปที่การสร้างฟีเจอร์ได้เต็มที่ แทนที่จะต้องมาจัดการกับความซับซ้อนของระบบหลังบ้าน

คู่มือการผสานฟีเจอร์ AI เข้ากับระบบและแอปพลิเคชันของคุณ

ในแบบที่สเกลได้ แยกส่วนการทำงานชัดเจน และปลอดภัย เพื่อให้ทีมนำไปปรับใช้ได้อย่างรวดเร็ว

การเปิดให้บริการ AI ผ่าน API ที่ชัดเจนและมีการระบุเวอร์ชัน

ให้การเรียกใช้งานโมเดลทั้งหมดดำเนินการผ่าน Backend หรือ API Gateway ของคุณเอง

Wrap ฟีเจอร์ LLM ไว้ใน SDK สำหรับการใช้งานฝั่ง Frontend

ช่วยให้ทีม Mobile และ Web ใช้งาน AI ได้ โดยไม่ต้องยุ่งเกี่ยวกับ Prompts, Tokens, การ Retry หรือรายละเอียดของโมเดล

การใช้ Event Streams หรือ Webhooks สำหรับโฟลว์แบบ Async ที่ไม่ผูกติดกัน

ช่วยให้ระบบปลายทางตอบสนองต่อผลลัพธ์ AI ได้ โดยไม่ต้อง direct coupling

จัดการเรื่องการ Retry, Rate Limits, และพฤติกรรมเฉพาะตัวของโมเดลภายใน SDK หรือ Platform Layer ของคุณ

ทีม Frontend ไม่ควรต้องจัดการกับความซับซ้อนของระบบเบื้องหลัง

คุณค่าเชิงกลยุทธ์

เนื่องจากทีมต่าง ๆ ทำงานแยกส่วนกันอย่างชัดเจน การอัปเกรด AI จึงไม่ส่งผลกระทบให้ฝั่ง frontend ต้องรื้อระบบใหม่ โมเดลต่างๆ จะกลายเป็นแบบ plug-and-play และคุณสามารถสลับผู้ให้บริการหลังบ้านได้ทันทีผ่าน interface ที่เสถียร และไม่กระทบฝั่งผู้ใช้งาน นอกจากนี้ ความปลอดภัย และการติดตามตรวจสอบระบบ ยังถูกรวบไว้ที่ส่วนกลางด้วย เนื่องจากทุกอย่างทำงานผ่านแพลตฟอร์มของคุณเอง

กล่าวโดยสรุปคือ AI ควรถูกมองเสมือนเป็นความสามารถหนึ่งของระบบหลังบ้านทั่วไป กล่าวคือ ต้องมีการระบุเวอร์ชัน ติดตามตรวจสอบ และซ่อนความซับซ้อนไว้ ไม่ใช่การเปิดให้เรียกใช้งาน API ของผู้ให้บริการโดยตรง

4 เสาหลักแห่งความสำเร็จ

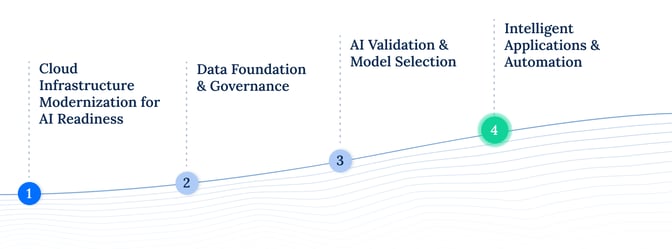

การสร้างระบบอัจฉริยะต้องอาศัยการลงทุนใน 4 เสาหลักนี้

Building the Next Generation

of Intelligent Systems

1. ปรับปรุงระบบคลาวด์ให้ทันสมัย เพื่อเตรียมความพร้อมสำหรับ AI

เริ่มด้วยการปรับปรุงระบบคลาวด์ให้มีประสิทธิภาพและขีดความสามารถตามที่ AI ต้องการ โมเดลจำเป็นต้องใช้พลังการประมวลผล พื้นที่จัดเก็บข้อมูล และระบบที่ตอบสนองได้รวดเร็ว ซึ่งโครงสร้างระบบแบบเดิมมักจะไม่สามารถรองรับได้

2. รากฐานและการกำกับดูแลข้อมูล

รากฐานข้อมูลที่แข็งแกร่งก็เป็นสิ่งสำคัญอย่างยิ่งเช่นกัน ซึ่งครอบคลุมถึงการรักษาความปลอดภัย การจัดระเบียบ และการเตรียมข้อมูลเพื่อนำไปใช้กับ AI รวมถึงการกำหนดมาตรฐานคุณภาพ การวางระบบควบคุมการเข้าถึง การปฏิบัติตามข้อกำหนด และการทำ data lineage ให้ชัดเจน เพราะท้ายที่สุดแล้ว คุณภาพของ AI ก็ขึ้นอยู่กับคุณภาพของข้อมูลที่นำมาใช้

3. การตรวจสอบความถูกต้องของ AI และการเลือกโมเดล

การตรวจสอบความถูกต้อง และการคัดเลือกโมเดล AI อย่างรอบคอบก็เป็นสิ่งจำเป็นเช่นกัน คุณจำเป็นต้องทดสอบ ประเมินผล และเลือกโมเดลที่เหมาะสมกับบริบทของคุณ ไม่ใช่การเลือกตามตัวเลือกที่กำลังเป็นกระแส ซึ่งหมายความว่าต้องมีการวัดความแม่นยำจากข้อมูลที่สะท้อนการใช้งานจริง การประเมินความคุ้มค่าระหว่างต้นทุนและประสิทธิภาพ และการตรวจสอบอคติและความน่าเชื่อถือ

4. แอปพลิเคชันอัจฉริยะและการทำงานอัตโนมัติ

สุดท้ายนี้ เป้าหมายคือการส่งมอบแอปพลิเคชันอัจฉริยะ ผ่าน API และ SDK ที่มีโครงสร้างตามที่ได้กล่าวไว้ก่อนหน้านี้ โดยทั้งหมดนี้จะขับเคลื่อนด้วยการทำงานอัตโนมัติและ AI ที่ทำงานร่วมกัน

การวางรากฐานเพื่ออนาคต

การสร้างผลิตภัณฑ์ AI-Native นั้นต้องใช้เวลา แอปพลิเคชันอัจฉริยะจำเป็นต้องอาศัยทั้งกลยุทธ์, โครงสร้างที่เป็นระบบ, และการทำงานร่วมกัน การใช้ทางลัดจะเพียงแต่นำไปสู่โซลูชันที่เปราะบาง ซึ่งจะพังทลายลงเมื่อเผชิญกับแรงกดดันจากการใช้งานจริง

ความสำเร็จเกิดจากการเริ่มต้นด้วยปัญหาที่ชัดเจน ไม่ใช่การมองหาว่าจะนำ AI ไปใช้ที่ไหน การตรวจสอบผลลัพธ์อย่างถี่ถ้วนก่อนที่จะสเกล และการสร้างบนรากฐานทางเทคนิคที่แข็งแกร่ง การจะทำเช่นนี้ได้ จำเป็นต้องมอง AI เป็นแผนงานเชิงกลยุทธ์ที่ต้องอาศัยความร่วมกันระหว่างทีม Product, Engineering, Data, และทีมธุรกิจ

แนวทางนี้จึงไม่ใช่แค่การเพิ่มฟีเจอร์ AI เพียงเพื่อบอกว่ามี แต่หัวใจสำคัญคือการคิดทบทวนใหม่ทั้งหมด ทั้งในเรื่องกระบวนการทำงาน การบริการลูกค้า และการสร้างคุณค่า โดยใช้ AI เป็นเครื่องมือขับเคลื่อนการเปลี่ยนแปลงให้เกิดขึ้นจริง

ในช่วงไม่กี่ปีข้างหน้านี้ เราจะได้เห็นการเปลี่ยนแปลงจากการเพิ่มฟีเจอร์ AI ไปสู่การสร้างรากฐานแบบ AI-first องค์กรที่จะประสบความสำเร็จคือองค์กรที่มอง AI ไม่ใช่แค่เครื่องมือชิ้นหนึ่ง แต่คือกรอบความคิดใหม่ในการวางระบบ

หากพร้อมที่จะสร้างโปรเจกต์แล้ว

หากคุณพร้อมที่จะเปลี่ยนไอเดีย AI ที่ยิ่งใหญ่ ให้เป็นแอปพลิเคชันอัจฉริยะที่ใช้งานได้จริง จุดเริ่มต้นสำคัญคือการมีกลยุทธ์และการลงมือทำที่ถูกต้อง Seven Peaks Software มีประสบการณ์ตรง และได้เห็นแล้วว่าโครงสร้างและการกำกับดูแลที่เหมาะสม สามารถพลิกโฉมไอเดีย AI เหล่านั้นให้กลายเป็นโซลูชันระดับองค์กรที่ยั่งยืนได้อย่างไร แม้ว่าเส้นทางจากแนวคิดไปสู่การใช้งานจริงจะเต็มไปด้วยความซับซ้อน แต่หากมีรากฐานที่แข็งแกร่ง มันก็สามารถเกิดขึ้นได้จริง

ติดต่อเราได้ที่ sales@sevenpeakssoftware.com เพื่อเริ่มต้นแอปอัจฉริยะจากไอเดียของคุณ

Leif Mork

VP ของ Digital Products ที่ Seven Peaks

Leif (head of digital products) มีความเชี่ยวชาญในการผลักดันไอเดีย AI ที่ท้าทาย จากแนวคิดไปสู่การใช้งานจริงที่สเกลได้ เขาทำหน้าที่กำหนดกลยุทธ์ผลิตภัณฑ์ AI พัฒนาแอปพลิเคชันแบบ AI-Native และสร้างความมั่นใจว่าระบบอัจฉริยะจะได้รับความไว้วางใจจากองค์กรในระยะยาว

.jpg?width=1765&height=1765&name=2023_VP%20Engineering_Leif%20Mork_02%20(1).jpg)